Представьте, что вам нужно построить высотное здание, но с каждым новым этажом рабочие забывают, как уложили фундамент и нижние уровни. Именно с такой проблемой сталкиваются нейросети — чем больше слоев, тем сложнее передавать информацию без потерь. ResNet стала революционным решением этой проблемы, позволив нейросетям становиться все глубже, не теряя точности.

Узнайте, как работает остаточная нейронная сеть, в чем суть ее архитектуры и почему ResNet стала прорывом в глубоком обучении моделей.

Что такое ResNet

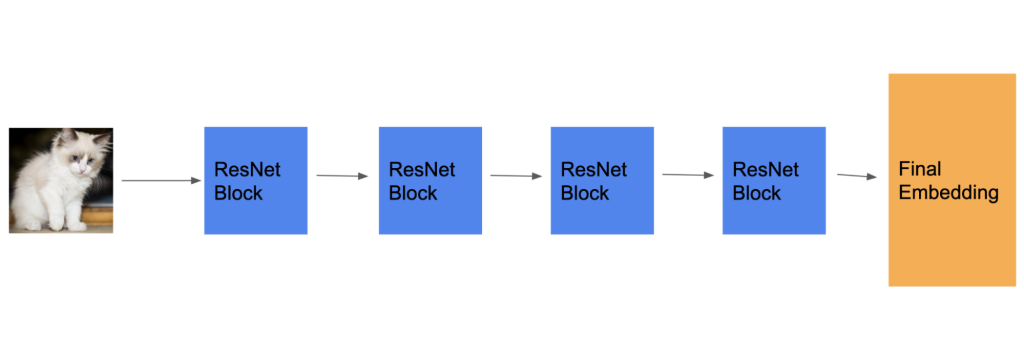

ResNet (Residual Neural Network) — это архитектура нейронных сетей, которая совершила революцию в глубоком обучении. Главная идея ResNet — использование остаточных (skip) соединений. Они позволяют нейросети быть очень глубокой и избегать проблемы исчезающего градиента, когда сигналы, передаваемые между слоями, затухают до нуля.

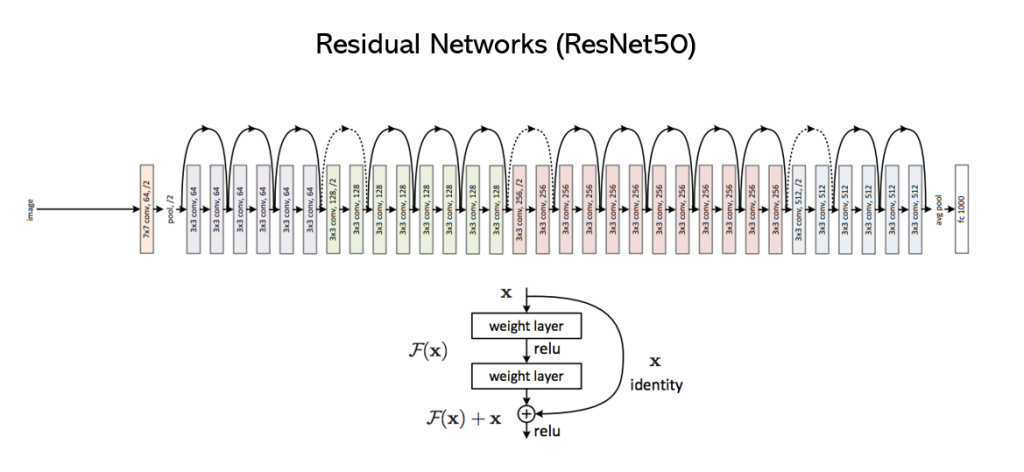

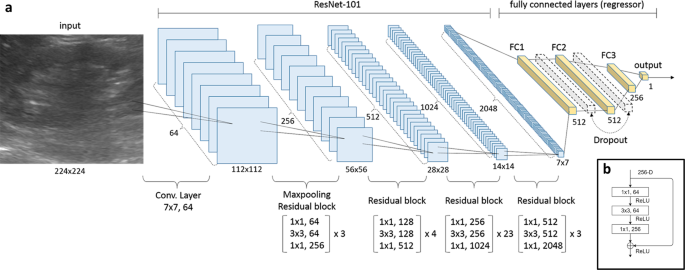

В традиционных нейронных сетях с увеличением количества слоев обучение становится сложнее: градиенты либо исчезают, либо становятся нестабильными. ResNet решает эту проблему с помощью остаточных блоков, благодаря которым информация проходит напрямую через несколько слоев, минуя некоторые вычисления. Это не только ускоряет обучение, но и позволяет создавать сверхглубокие модели: ResNet-50, ResNet-101 и ResNet-152.

Благодаря своей уникальной структуре ResNet стала основой для множества современных моделей в компьютерном зрении, распознавании изображений, классификации и других задачах искусственного интеллекта.

Как устроена архитектура ResNet

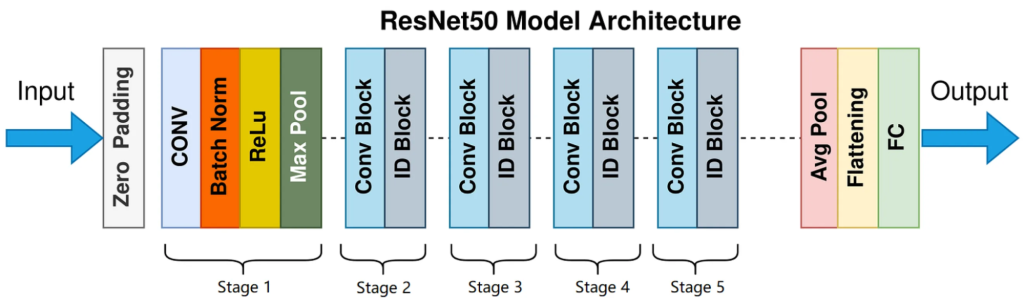

Архитектура ResNet (Residual Network) произвела революцию в мире глубокого обучения, решив одну из главных проблем — исчезающие градиенты в очень глубоких нейронных сетях. Вот ее основные компоненты:

- Остаточные блоки (Residual Blocks). Именно они помогают нейросети передавать информацию через несколько слоев, минуя некоторые из них. Остаточные блоки — это своеобразные обходные пути. Нужно отметить, что ResNet не соединяет слои последовательно, а использует связи skip connections. Благодаря им информации «перепрыгивает» через слои, сохранялась практически неизменной, даже если модель состоит из сотен слоев.

- Сверточные слои и функции активации. Каждый остаточный блок включает сверточные слои с ядрами 3×3 и функции активации ReLU. Эти элементы добавляют нелинейность, позволяя модели улавливать сложные закономерности в данных.

- Нормализация и оптимизация. Для стабилизации обучения ResNet использует Batch Normalization. Этот метод нормализует выходы каждого слоя, ускоряет обучение и улучшает стабильность нейросети.

- Масштабируемость. ResNet легко адаптируется под разные задачи. Например, ResNet-18 содержит 18 слоев, ResNet-50 — 50, а ResNet-152 — 152 слоя. Это позволяет выбирать модель в зависимости от сложности задачи и доступных вычислительных ресурсов.

Благодаря этим особенностям ResNet стала стандартом для задач классификации, сегментации и детектирования объектов на изображениях.

Как обучать нейросеть ResNet

Обучение ResNet — это процесс, который требует внимания к деталям. Ниже представили основные этапы, которые помогут вам добиться успеха.

Предобучение и инициализация

Обучение нейронной сети ResNet обычно начинается с предобученных весов, например, на датасете ImageNet. Это позволяет модели быстрее адаптироваться к новым данным, так как она уже знает базовые признаки изображений. Инициализация весов также играет ключевую роль. Правильная инициализация помогает избежать проблем с исчезающими или взрывающимися градиентами.

Градиентный спуск и оптимизаторы

Для обучения нейросети ResNet чаще всего используется алгоритм градиентного спуска (Gradient Descent). В процессе обучения нейросеть пытается минимизировать ошибку или потери. Градиентный спуск помогает ей найти наилучшие значения для весов нейросети, шаг за шагом двигаясь в сторону минимальной ошибки. Это похоже на процесс спуска с горы: модель «спускается» по склону, пытаясь найти самую низкую точку, где ошибка минимальна.

Также для обучения используют оптимизаторы — методы, которые помогают модели делать это быстрее. Например, оптимизатор Adam, который адаптирует скорость обучения в зависимости от результатов предыдущих шагов.

Остаточные связи

Остаточные связи — это фишка ResNet. Они позволяют данным «перепрыгивать» через слои, что предотвращает исчезновение градиентов и делает глубокое обучение сетей более стабильным.

Регуляризация и нормализация

Чтобы модель не переобучалась, используются методы регуляризации:

- Dropout — случайное отключение нейронов во время обучения, что помогает сети обобщать данные.

- Batch Normalization — нормализация выходов слоев, которая ускоряет обучение и улучшает стабильность.

Настройка гиперпараметров

При обучении модели есть несколько параметров, которые нужно настроить:

- Скорость обучения — показатель того, как быстро модель учится. Важно учесть, что слишком высокая скорость приведет к нестабильности, а низкая — замедлит процесс.

- Количество эпох — метрика, показывающая, сколько раз модель проходит через весь набор данных. Чем глубже сеть, тем больше эпох может потребоваться.

- Размер батча — влияет на производительность и стабильность обучения.

Мониторинг и отладка

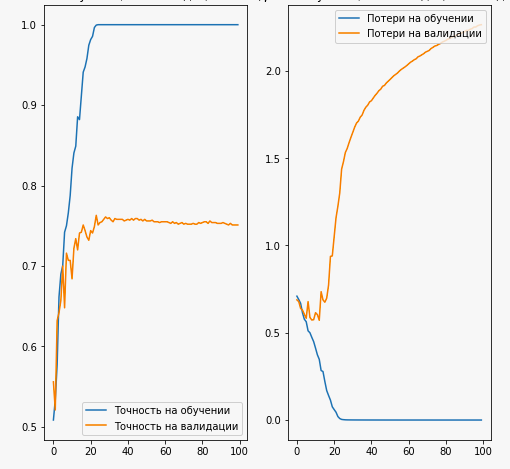

Обучение нейросети нельзя пускать на самотек. Важно следить за динамикой. Для этого используют графики потерь и точности. Они помогают вовремя обнаружить проблемы. Например, переобучение или недостаточную сходимость.

Как использовать ResNet

На первый взгляд ResNet и ее функции могут показаться слишком сложными и подходящими лишь для узкого применения. Но это так. Вот лишь часть вариантов ее использования:

Классификация изображений. Сеть ResNet чаще всего используется для распознавания объектов на изображениях. Например, предобученные версии модели базируются на огромном датасете ImageNet, содержащем миллионы изображений и тысячи классов. Это позволяет быстро адаптировать ResNet для решения задач классификации, даже если у вас небольшой датасет. Пример: распознавание пород животных, классификация медицинских снимков, идентификация продуктов на полках магазинов.

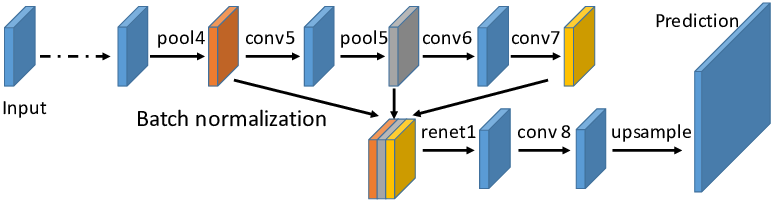

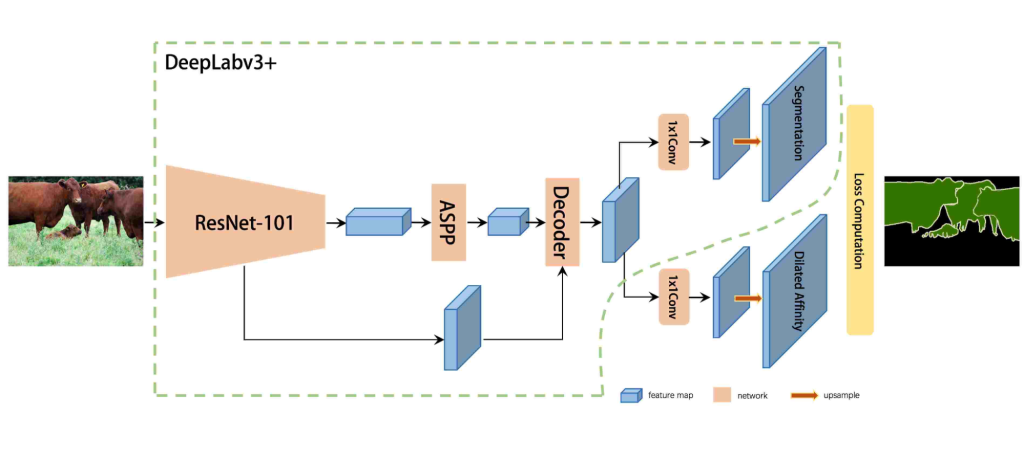

Обнаружение и сегментация объектов. ResNet легко интегрируется в более сложные архитектуры для решения задач обнаружения и сегментации объектов. Например, в Faster R-CNN или Mask R-CNN. Эти модели не только находят объекты на изображении, но и точно определяют их границы. Пример: обнаружение пешеходов и конкретных машин на снимках, сегментация опухолей на медицинских изображениях.

Генерация изображений. Нейронная сеть также используется в генеративных моделях, например, в StyleGAN или DeepDream. В подобных задачах ResNet помогает выделять ключевые визуальные признаки, которые затем используются для создания новых изображений или преобразования существующих. Пример: создание искусственных портретов, художественная обработка фотографий.

Обработка медицинских изображений. В медицине сеть ResNet применяется для анализа рентгеновских снимков, МРТ и других медицинских данных. Модель помогает врачам быстрее и точнее диагностировать заболевания. Пример: автоматическая диагностика COVID-19 по рентгеновским снимкам легких, обнаружение опухолей на МРТ.

Анализ видео. ResNet используется для анализа видеопотоков, где требуется идентификация объектов или действий. Это особенно полезно в системах видеонаблюдения, распознавании жестов и спортивной аналитике. Пример: подсчет посетителей в магазине, анализ движений спортсменов, распознавание подозрительных действий в аэропортах.

Творческое применение. ResNet можно использовать и для style transfer — переноса стиля. Это позволяет преобразовывать изображения, придавая им художественный стиль известных картин или создавая уникальные визуальные эффекты. Пример: создание фильтров для фото, генерация арт-объектов.

Заключение

ResNet — это не просто инструмент, а фундамент, на котором строятся многие современные технологии. Рекуррентные связи и многослойная архитектура делают эту сеть универсальной для решения самых разных задач. А благодаря своей способности оптимизировать процесс обучения и сопоставлять сложные данные, ResNet на сегодняшний день остается одной из самых популярных архитектур в глубоком обучении.

Материал проверен экспертом

Дмитрий руководил такими медиа-проектами, как CPA Mafia, CyberAff, ProTraffic, AffTimes, CPA Monstro и Affiliate Valley. Его опыт дополнил и краткий стаж работы менеджером по работе с вебмастерами в нутра-партнерке WebVork, что обогатило его знания в области affiliate-маркетинга.

31 декабря 2024 г. Дмитрий покинул должность руководителя медиа-проектов в холдинге ADSBASE. На текущий момент возглавляет CPA.LIVE и форум ADDSET.

Подтверждая свою экспертность в digital-маркетинге, Дмитрий обладает внушительным списком сертификатов.